Betrek burgers bij experimentele proeftuinen AI

In het vandaag gepubliceerde paper ‘Op zoek naar de mens in AI’ pleiten we ervoor om experimentele omgevingen in te richten waarin AI-systemen voor algoritmische publieke besluitvorming worden beproefd. Door verschillende betrokkenen zoals burgers, gebruikers en beleidsmakers daarbij te betrekken komen beperkingen van de systemen en mogelijke negatieve aspecten als onbedoelde discriminatie, ongelijkheid of uitsluiting eerder naar boven om te kunnen worden gecorrigeerd vóór de daadwerkelijke invoering.

Algoritmische besluitvorming publieke sector

Een recente studie van TNO laat zien dat het gebruik van AI binnen de publieke dienstverlening de afgelopen twee jaar sterk is toegenomen. Overheidsorganisaties maken steeds meer gebruik van AI om in zicht te krijgen in maatschappelijke vraagstukken en bij het nemen van besluiten. Bijvoorbeeld voor de snellere afhandeling van visumaanvragen, om beter inzicht te krijgen in armoede- of schuldenproblematiek of voor onderhoud aan bruggen en sluizen. Dit wordt algoritmische besluitvorming genoemd, waarbij het (AI-)algoritme geheel of gedeeltelijk geautomatiseerd de uitkomst bepaalt.

Aan de toepassing van deze zogenoemde algoritmische besluitvorming kleven ook nadelen. Er zijn verschillende gevallen bekend waarbij die toepassing onbedoelde negatieve maatschappelijke gevolgen had, zoals discriminatie, ongelijkheid of uitsluiting. Om deze gevolgen te voorkomen richt bestaand en nieuw beleid zich al op het opstellen van normenkaders voor de ontwikkeling van AI en het reguleren van AI toepassingen. In die kaders zijn principes voor verantwoordelijke toepassing van AI geformuleerd, gebaseerd op mensenrechten. Veel normenkaders zijn echter gericht op AI-ontwikkelaars, dus aan de voorkant van het proces, in plaats van op degenen die de technologie toepassen. Er is mede daardoor een gebrek aan transparantie en uitlegbaarheid van de AI bij de toepassing.

Beperkingen van huidig AI-beleid en toepassing

In het paper ‘Op zoek naar de mens in AI (pdf)’ analyseren we vijftien veelgebruikte normenkaders. Het blijkt dat ze veel verschillende normen bevatten maar niet duidelijk maken wie bepaalt hoe ze worden toegepast. Daarnaast zijn veel normenkaders niet gericht op degenen die de technologie toepassen maar op de ontwikkelaars. Dit zijn vaak commerciële partijen die slechts op onderdelen betrokken zijn bij de uitvoering van de besluitvorming. De eindverantwoordelijkheid voor het systeem ligt in veel gevallen echter bij partijen die de AI-systemen toepassen voor geautomatiseerde besluitvorming. Veel gehanteerde methodieken zijn daarom meestal beter geschikt om achteraf te beoordelen welke impact AI-systemen hebben.

Het opstellen van normenkaders vooraf en toetsing van de systemen achteraf is onvoldoende om ongewenste negatieve effecten te voorkomen zoals bij het anti-fraudeprogramma Systeem Risico Indicatie (SyRI) van de overheid dat vorige jaar van tafel moest. Een andere beperking bij veel huidige AI-systemen in de publieke sector is er een gebrek aan transparantie en uitlegbaarheid bij de toepassing ervan. Burgers weten het vaak niet eens als de overheid op een bepaald vlak AI-systemen inzet. En als dat wel duidelijk is, weten burgers niet welke rol zo’n systeem speelt bij overheidsbeslissingen. Ze weten dan dus ook niet op basis van welke data die beslissingen tot stand komen. Verder is er nog veel onduidelijk over de langetermijngevolgen van algoritmische besluitvorming en welke effecten er kunnen optreden.

Download het paper

Op zoek naar de mens in AI

TNO methodiek om alle partijen te betrekken

Op basis van hoe AI in de publieke sector op dit moment wordt gereguleerd en een analyse van bestaande normenkaders en methodieken hebben onze onderzoekers daarom een aanpak ontwikkeld om AI-systemen voor algoritmische besluitvorming in de publieke sector te beproeven. Bij deze ‘Dynamische impact assessment methodiek voor verantwoordelijke algoritmische besluitvorming’ is het cruciaal dat de verschillende belangen gedurende het experiment meegewogen worden met de toepassing van het AI-systeem. Dit houdt in dat partijen zoals ontwikkelaars, beleidsmakers, overheidsfunctionarissen en burgers betrokken worden om alle belangen mee te wegen. In samenwerking met die partijen wordt volgens die methodiek eerst verkend of AI überhaupt een oplossing kan bieden in een systeem, waarna in een afgeschermde omgeving voor experimenten de toepassing kan worden beproefd. Hierdoor worden onbedoelde nadelige gevolgen in een vroeg stadium geïdentificeerd en kan het AI-systeem aangepast worden.

In deze afgeschermde omgeving wordt op dynamische wijze controle en toezicht uitgeoefend op de toepassing van AI-systemen, ook op lange termijn. Afhankelijk van de complexiteit van het te beproeven systeem, schatten we in dat een dergelijke proeftuin ongeveer anderhalf jaar duurt. Van belang is ook dat de resultaten op begrijpelijke wijze worden gecommuniceerd. Gedurende de toepassing wordt gerapporteerd wat de (verwachte) risico’s en impact zijn. Hiervoor moet een gestandaardiseerde ‘bijsluiter’ worden ontwikkeld die begrijpelijk is voor burgers.

Neem contact met ons op

Laat je verder inspireren

TNO Unboxed #1 | GPT-NL: het Nederlandse taalmodel

Werken aan betrouwbare AI

AI-systeem voor persoonlijk advies gezonde leefstijl

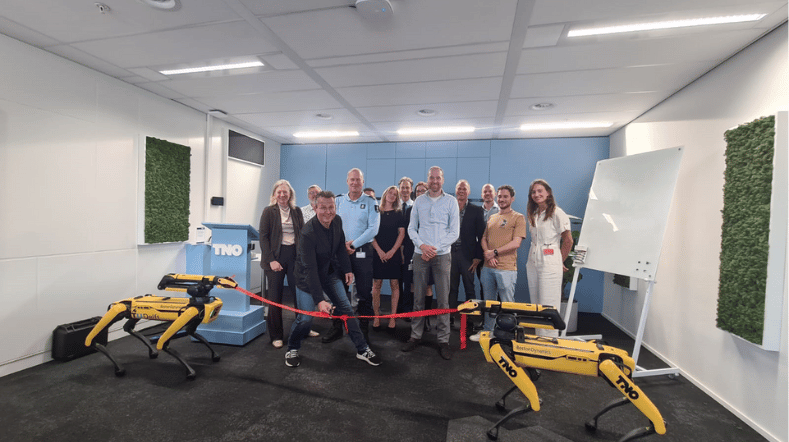

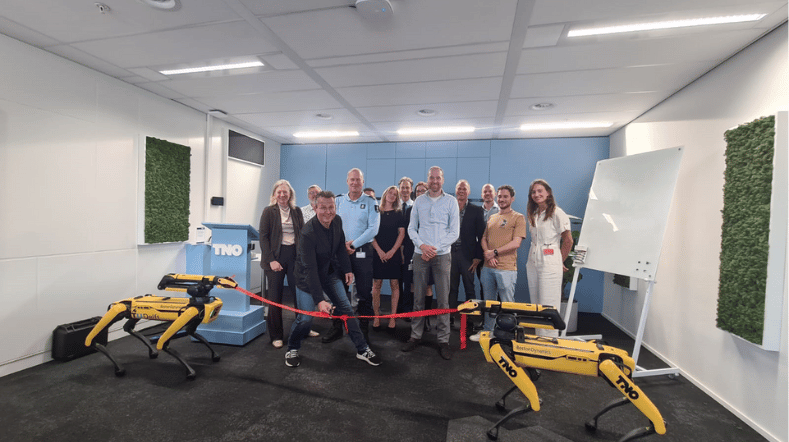

Nieuw consortium ontwikkelt geavanceerde AI voor bewakingsrobots

Human-AI, want samen kunnen mens en machine grotere uitdagingen aan