Hoe navigeer je op weg naar ethiek in AI?

De opmars van Artificial Intelligence is niet te stuiten. Onder meer banken, verzekeraars, transportbedrijven, onderwijsinstellingen en de overheid maken al tijden gebruik van AI. Door de razendsnelle ontwikkelingen profiteren niet alleen grote bedrijven van de mogelijkheden, AI is nu toegankelijk voor iedereen.

Marc Steen, senior onderzoeker bij TNO en schrijver van het boek ‘Ethics for People Who Work in Tech’, vertelt over ethiek in AI. “We komen bijna dagelijks in aanraking met Kunstmatige Intelligentie, onder meer via social media. Meer bewust gebruik van AI maken we bijvoorbeeld als we ChatGPT gebruiken. Zoals de advocaat deed die zijn pleidooi door ChatGPT liet schrijven en de havo 4-leerling die een werkstuk inleverde dat door deze chatbot was samengesteld.

In deze twee voorbeelden pakte het gebruik van AI niet zo goed uit. Het pleidooi bevatte namelijk niet-bestaande precedenten en het taalgebruik in het werkstuk was van een niveau dat nog nooit eerder gezien was bij de betreffende leerling. Blunders van veel grotere orde zijn er helaas ook. We kennen allemaal de kinderopvangtoeslagaffaire, waarin AI-algoritmes mensen onterecht aanwezen als fraudeurs.

Zijn we allemaal even ethisch?

Wat vinden ‘wij’ van bovenstaande voorbeelden? De mening van veel mensen zal zijn dat de advocaat en de leerling hun werk zelf hadden moeten doen en dat de overheid veel zorgvuldiger te werk had moeten gaan.

Waarom vinden ‘wij’ dat? Omdat de meesten van ons een ethisch kompas hebben en we denken en handelen (vaak onbewust) vanuit waarden die te vinden zijn in bijvoorbeeld de deugdethiek. Deugdethiek gaat onder meer over ‘deugden’ als eerlijkheid, rechtvaardigheid en moed. Deugden die veel mensen toepassen in hun leven en ook belangrijk zijn voor bedrijven die ethiek willen integreren bij de ontwikkeling van AI-toepassingen.

Deugdethiek is bij uitstek nuttig voor IT-professionals. Welke deugden heb je als professional nodig in je werk? Rechtvaardigheid, bijvoorbeeld als je werkt aan een algoritme en wilt voorkomen dat die discriminerende output geeft. Moed, als je je zorgen wilt uitspreken over ongewenste neveneffecten van je project.”

Deugdethiek in een notendop

Deugdethiek start, wat betreft het Westen, met Aristoteles in Athene. Hij formuleerde het als volgt: Deugdethiek veronderstelt dat er voor alles ultieme doelen bestaan. Een beukennoot heeft als doel om uit te groeien tot een beukenboom.

Wij, als mensen, streven ernaar onze menselijke capaciteiten te ontwikkelen, bijvoorbeeld onze capaciteiten voor reflectie, communicatie, samenwerking of creatie – zodat we een betekenisvol en vervullend leven kunnen leiden. Deugdenethiek gaat over het creëren van een samenleving waarin mensen hun capaciteiten kunnen ontwikkelen en goed kunnen samenleven en floreren.

Is dat nou allemaal nodig, die ethiek?

“Soms reageren mensen terughoudend op het woord ethiek”, vertelt Steen over zijn ervaringen. “Ze stellen zich iemand voor met een opgeheven vinger. Ethiek is dan een barrière die innovatie tegenhoudt. Het is mijn mening dat ethiek niet gezien moet worden als obstakel, maar als stuur. Met ethiek als stuur kun je je project beter op de goede weg te houden, veilig rijden en de juiste afslagen nemen.

Een goede reden om ethiek te integreren in een project is omdat technologie nooit neutraal is. Wie bijvoorbeeld een algoritme gaat ontwikkelen, verzamelt eerst data, om het algoritme of taalmodel te trainen. Bij het verzamelen van die data maken mensen keuzes, zijn onbewust bevooroordeeld. En die keuzes zorgen voor bias in de output van het algoritme.

Ik merk gelukkig dat ethiek onder technici steeds meer draagvlak vindt. Wanneer ik tijdens een presentatie aan professionals vraag wie ethiek wil integreren, steekt vrijwel altijd de overgrote meerderheid hun hand op. Hetzelfde grote aantal handen zie ik alleen niet terug als ik vraag wie weet hoe ze ethiek kunnen toepassen. Dat is precies het gat dat ik opvul met mijn praktische aanpak van ethiek.”

“Het toepassen van ethiek in AI wordt in Europa steeds meer gemeengoed. Gelukkig maar; het kan een mooi alternatief vormen voor de Verenigde Staten aan de ene kant en China aan de andere kant.”

Aan de slag met ethiek in techniek en AI

“Ethiek toepassen hoeft niet heel ingewikkeld te zijn”, zegt Steen. “Ik adviseer drie praktische stappen die je kunt organiseren als een iteratief proces. Ik noem het ‘Rapid Ethical Deliberation’. Het sluit aan bij Agil en Scrum.

- Leg de issues of risico’s van het project op tafel; waar maak je je zorgen over, wat zou er mis kunnen gaan? Wees hierin moedig en eerlijk, ook als zoiets uitzoeken extra tijd of geld kost.

- Organiseer gesprekken waarin je die issues van verschillende kanten bekijkt. Maak hierbij naast deugdethiek bijvoorbeeld ook gebruik van de perspectieven in gevolgenethiek, plichtethiek en relatie-ethiek.

- Dit is de belangrijkste stap, je gaat nu ethiek praktisch maken en je project sturen. Neem besluiten, liefst op een iteratieve manier. Onderneem actie, probeer iets uit, evalueer de uitkomsten en stuur bij.

Er is geen garantie dat alles goed zal gaan wanneer je deze stappen volgt. Wel zeker is dat je transparant en accountable kunt zijn over de stappen die je hebt genomen; je hebt serieus en oprecht gekeken naar issues, daarover gesproken met verschillende mensen en hebt maatregelen genomen en de effecten daarvan geëvalueerd.

Je kunt een dergelijk proces op verschillende manieren organiseren; groot of klein, als workshop van anderhalf uur met vier mensen, of breder met verschillende experts van buiten de organisatie en als terugkerend onderdeel van projectmanagement.”

Vormen van ethiek samengevat

Bij het toepassen van gevolgenethiek kijk je naar de positieve en negatieve gevolgen van de uitkomst van je project. Je vergelijkt de verschillende opties de voordelen te vergroten en de nadelen te verkleinen.

Neem bijvoorbeeld ChatGPT, dat als voordeel heeft dat het voor veel mensen gemakkelijker wordt om goede teksten te leveren. Een nadeel is dat bad actors ChatGPT kunnen gebruiken om snel en goedkoop desinformatie te genereren. Ook worden er vragen gesteld over copyrights van teksten, afbeeldingen en muziek. Mag DJ David Guetta aan AI vragen om een tekst te schrijven in de stijl van Eminem en zijn stem te kopiëren om vervolgens deze track als ‘grap’ te laten horen bij een optreden? Het is geen verrassing dat Eminem het niet grappig vond.

De complexiteit bij gevolgenethiek ligt in het bepalen het kader waarbinnen je kijkt en het verdelen van de gevolgen tussen verschillende groepen mensen. Maak je bij het kijken naar de gevolgen van innovaties als ChatGPT het kader groter, dan kun je ook nadelen zien voor het milieu bij het winnen van materialen voor de chips die gebruikt worden en van het energieverbruik voor het trainen van zo’n taalmodel.

Plichtethiek is een ethisch perspectief dat focust op plichten en rechten. De plichten van de ene partij kunnen conflicteren met de rechten van de andere partij. Een voorbeeld is veiligheid tegenover privacy; een gemeente heeft als plicht te zorgen voor een veilige leefomgeving en hangt daarom camera’s op. Maar schendt dit niet het recht op privacy van burgers? Moet je kiezen tussen veiligheid of privacy? In de praktijk zijn er technologieën die veiligheid en privacy combineren.

Relatie-ethiek houdt zich bezig met het analyseren van de impact van technologie op menselijke relaties en interacties, en vragen over de verdeling van macht die kan veranderen door de introductie van technologie. Veel mensen projecteren allerlei menselijke eigenschappen op ChatGPT, zoals intelligentie of creativiteit. Dat doet denken aan chatbot ELIZA die al in de jaren ’60 blootlegde hoe makkelijk mensen intelligentie en empathie toekennen aan een chatbot.

Relatie-ethiek kan helpen om technologie zo te ontwikkelen dat mensen elkaar meer menselijk kunnen bejegenen en minder als object. Je kunt je bijvoorbeeld een app voorstellen die als filter dient voor tekstberichten. De app detecteert direct, onvriendelijk, onbeschoft of dreigend taalgebruik detecteert in een conversatie en je ‘verplicht’ een minuut bedenktijd voor je verder gaat.

ELIZA was de naam van een van de eerste chatbots, tussen 1964 en 1966 geprogrammeerd en getest door Joseph Weizenbaum. ELIZA was een heel eenvoudige chatbot en in basis bedoeld om te demonstreren dat je met weinig code (+/- 200 regels) een chatbot kunt maken die heel overtuigend is. Weizenbaum had de chatbot geprogrammeerd als een soort rogeriaanse psychiater. Een gesprek met ELIZA verliep bijvoorbeeld als volgt:

- ELIZA: “Hallo, vertel me wat je dwars zit”

Testpersoon: “Ik voel me ellendig.” - ELIZA: “Hmm, je voelt je ellendig. Kun je me daar meer over vertellen?”

Testpersoon: “Ja, mijn partner dit en dat …” - ELIZA: “Goh, je partner dit en dat. Dat is interessant”

Testpersoon: “Ja, hij doet zus en zo.” - ELIZA: “Aha, hij doet zus en zo. Hoe lang speelt dat al? Kun je me daar meer over vertellen?”

ELIZA pikte slechts wat steekwoorden op en koppelde die aan standaardzinnen. Wat bleek? Heel veel mensen voelde zich enorm begrepen en echt gehoord. Zelf Weizenbaums eigen secretaresse was dol op de ‘ELIZA-psycholoog’.

Weizenbaum was zeer verrast door deze resultaten. Hij wilde aantonen dat een computer geen menselijke eigenschappen kan hebben, alleen oppervlakkige gesprekken. Met dit project demonstreerde hij juist dat mensen heel snel geneigd zijn om menselijke eigenschappen als bijvoorbeeld empathie toe te schrijven aan een computer of chatbot. Is het verrassend dat Joseph Weizenbaum een belangrijke criticus werd van AI?

Hoe staat het met ethiek in AI in de wereld?

“In de VS mogen tech-bedrijven zo’n beetje alles. Met als gevolg dat enkele grote bedrijven AI inzetten om invloed uit te oefenen op het gedrag van mensen. En in China, een ander AI-zwaargewicht, werkt de staat samen met tech-bedrijven om burgers te controleren en te beïnvloeden.

In de EU kunnen we een alternatief ontwikkelen op basis van publieke waarden, zoals vrijheid, gelijkheid, solidariteit en democratie. Het is goed dat de EU het voortouw neemt in wetgeving, zoals de DGA, DSA, DMA en de AI Act. We kunnen verwachten dat die, net als de GDPR, internationale werking zullen hebben.”

Meer weten?

Marc deelt zijn kennis over ethiek in AI via verschillende platformen.

- Bezoek zijn website Ethics for people who work in tech.

- Lees de samenvatting van zijn boek.

- Beluister aflevering 49 of aflevering 53 van de podcast AIToday Live.

Neem contact met ons op

Laat je verder inspireren

TNO Unboxed #1 | GPT-NL: het Nederlandse taalmodel

Werken aan betrouwbare AI

AI-systeem voor persoonlijk advies gezonde leefstijl

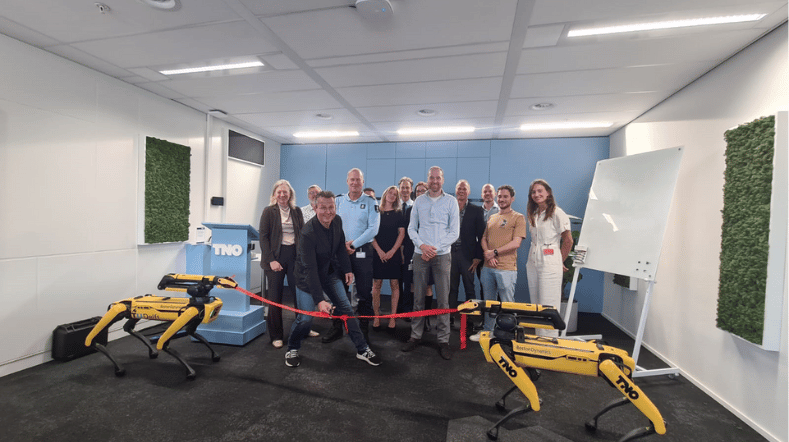

Nieuw consortium ontwikkelt geavanceerde AI voor bewakingsrobots

Human-AI, want samen kunnen mens en machine grotere uitdagingen aan